「便利だから」で、思考停止していませんか?

ChatGPT、業務で活用されていますか?

その使い方、本当に安全だと自信を持って言えますか?

先日、OpenAIが「ChatGPTの共有チャットがGoogle検索結果に表示される」という深刻な問題を受け、急遽機能を停止したニュースが世界を駆け巡りました。

これは遠い海外の話でも、他人事でもありません。

あなたの会社の機密情報が、気づかないうちに全世界に公開されている可能性があります。この記事では、何が起きたのかを正確に解説し、あなたの会社が今すぐ取るべき具体的なアクションを提示します。

第1章:一体何が起きたのか?事件の概要

事実の整理

Search Engine Journalなどの海外メディアの報道によると、事件の経緯は以下の通りです:

2025年7月の出来事

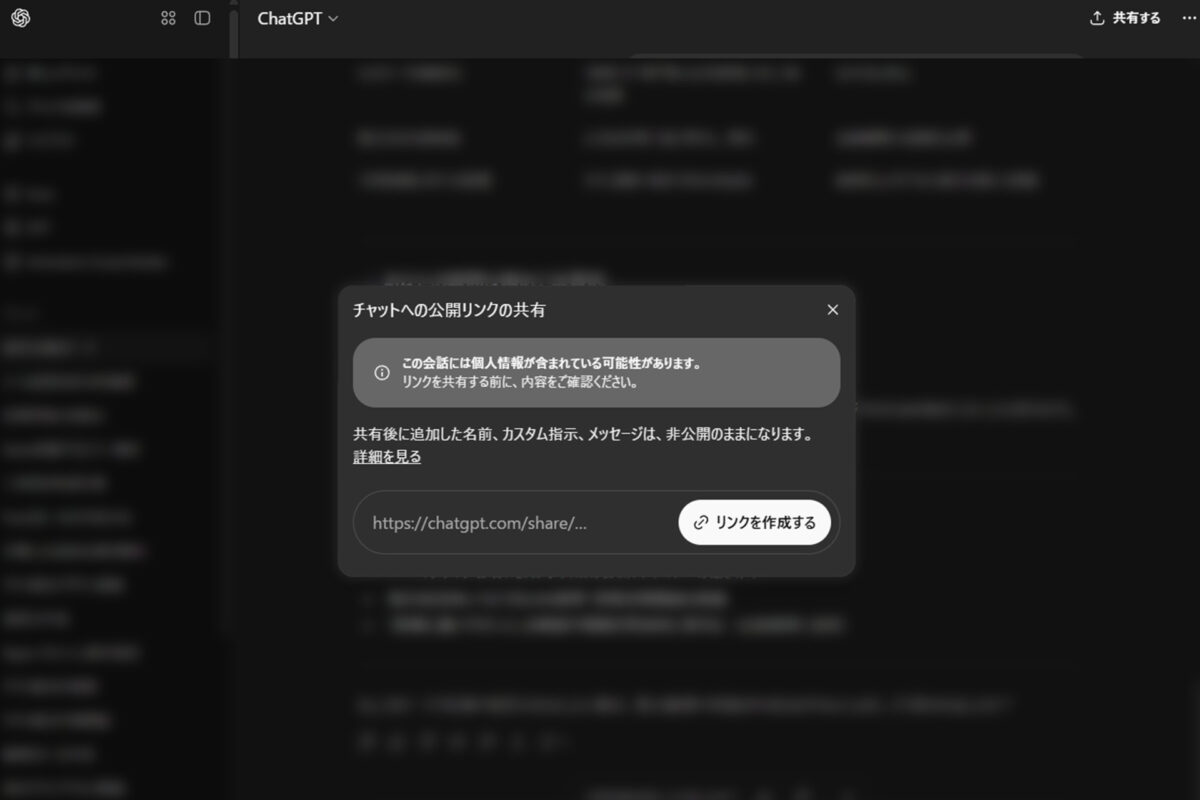

- ChatGPTには、チャット内容をURLで他者と共有する機能が存在していた

- 共有時に「検索エンジンにインデックスさせる」というオプションが設けられていた

- 多くのユーザーがこの設定の意味を理解せずに利用

- 結果として、個人名、履歴書、社内秘の企画書、顧客情報といった機密情報を含む数千のチャットがGoogle検索で丸見えの状態に

- OpenAIは「短期間の実験機能だった」として機能を緊急停止、検索インデックスからの削除を進めていると発表

問題の本質

この事件で最も恐ろしいのは、「ユーザーが意図せず、機密情報を公開してしまった」という点です。

悪意のあるハッカーによる攻撃でも、システムの脆弱性でもありません。普通の会社員が、普通に業務でChatGPTを使い、「同僚と共有したい」という善意から起きた情報漏洩なのです。

第2章:なぜこれが「あなたの会社」にとって致命傷になり得るのか?

「うちの会社は大丈夫」

そう思っている経営者・担当者の方、本当にそう言い切れますか?

以下の危険なシナリオは、どの会社でも明日起こり得る現実です。

🚨 シナリオ1:営業担当者の場合

状況: 田中営業主任(仮名)が新規開拓のため、顧客リストの整理をChatGPTに依頼

やりとり:

田中さんの投稿:「この顧客リストを業界別に分類して」

(Excel の顧客情報1,000件を貼り付け)

- 会社名、担当者名、電話番号、メールアドレス、売上高、購買履歴

共有理由: 「部下にも見せたい」「上司に報告したい」という善意から共有リンクを作成

結果: Google検索で「[会社名] 顧客リスト」と検索すると、トップに表示される事態に

🚨 シナリオ2:開発担当者の場合

状況: 山田エンジニア(仮名)がバグ修正のため、ChatGPTにソースコードの解析を依頼

やりとり:

山田さんの投稿:「このコードのバグを見つけて修正して」

(自社システムの認証部分のコード数百行を貼り付け)

- データベース接続文字列

- APIキー

- セキュリティロジック

共有理由: 「チームメンバーにも見てもらいたい」とリンク作成

結果: 競合他社や悪意のある第三者が、自社システムの脆弱性を特定できる状態に

🚨 シナリオ3:人事・管理部門の場合

状況: 佐藤人事部長(仮名)が採用業務効率化のため、ChatGPTを活用

やりとり:

佐藤さんの投稿:「この履歴書の要約と評価をして」

(応募者の履歴書PDFの内容を貼り付け)

- 氏名、住所、学歴、職歴

- 家族構成、趣味、志望動機

共有理由: 「他部署の管理職にも意見を聞きたい」とリンク作成

結果: 応募者の個人情報が検索エンジンに永続的に残り、個人情報保護法違反、さらには損害賠償請求のリスクも

結論:たった一人の「うっかりミス」が企業を破滅させる

悪意は一切ありません。みんな「会社のため」「効率化のため」という善意で行動しています。

しかし、たった一人の従業員のうっかりミスが、企業の信頼を揺るがす重大な情報漏洩に繋がる——これが現代のAI時代における最大のリスクなのです。

第3章:今すぐ実行すべき!2つの緊急対策

不安を煽るだけでは意味がありません。今すぐできる具体的な解決策をお伝えします。

対策1:【セルフチェック】過去の共有リンクを確認・削除する

所要時間:5分

すべての従業員に、以下の手順で確認・削除を指示してください:

- ChatGPTにログイン

- 右上のプロフィール画像をクリック

- 「Settings」を選択

- 左メニューから「Data controls」を選択

- 「Shared links」セクションを確認

- 意図しないリンクがあれば「Delete」をクリック

⚠️ 特に注意すべき共有リンク

- 業務関連の内容を含むもの

- 会社名、顧客名、個人名が含まれるもの

- コード、設計書等の技術情報を含むもの

- 数字、データ、リストを含むもの

対策2:【社内展開】従業員への注意喚起テンプレート

以下のテンプレートをコピーして、今日中に全社員に送信してください:

件名:【重要・緊急】ChatGPTの利用に関する注意喚起

社員の皆様

業務でのChatGPT利用に関し、緊急の注意喚起です。

先日、ChatGPTの共有リンク機能により、機密情報が意図せず外部に公開されるという重大な事案が発生しました。

つきましては、以下のルールを即日徹底してください。

【緊急実施事項】

- 過去の共有リンクの確認・削除(今日中に実施)

- ChatGPT設定画面から「Shared links」を確認

- 業務関連のリンクは全て削除

- 情報入力の禁止(即日適用)

- 顧客情報、個人情報の入力禁止

- 社外秘情報(コード、企画書、議事録等)の入力禁止

- 会社名、実名の入力は最小限に

- 共有リンクの原則禁止(即日適用)

- 業務利用で作成したチャットの共有リンクは原則発行しない

- やむを得ず共有する場合は、上長の事前承認を必須とする

違反した場合、情報漏洩として重大な懲戒処分の対象となります。

ご質問がある方は、速やかに情報システム部まで連絡してください。

安全な利用にご協力をお願いします。

担当者様からよくいただくご質問(Q&A)

どのAIツールを使うかに関わらず、リスクの本質は同じです。問題はツールそのものではなく、**「入力した情報がどのように扱われるかを理解せずに使ってしまうこと」**にあります。便利な共有機能や連携機能が、思わぬ情報漏洩の裏口になる可能性があります。特定のツールが安全と考えるのではなく、「機密情報は原則として入力しない」というルールを全ツール共通で適用することが重要です。

最初のステップとして、まずは「社内でのAI利用実態の把握」から始めましょう。どの部署の誰が、どんな目的で、どのAIツールを使っているかを簡単なアンケートで調査します。その上で、「禁止事項(例:個人情報・顧客情報の入力禁止)」「利用時の注意点」「相談窓口」といった最低限の項目からルールを定め、徐々に具体化していくのが現実的な進め方です。もちろん、私たちがそのプロセス全体をサポートすることも可能です。

ガイドラインの策定と、その「浸透・定着」はセットで考える必要があります。ただルールを通知するだけでなく、「なぜこのルールが必要なのか」という背景(今回のような事件の実例など)を丁寧に説明する研修会の実施が非常に効果的です。また、定期的なリマインドや、Microsoft Purviewのような技術的な情報漏洩対策(DLP)ツールを組み合わせることで、ルール遵守の実効性を高めることができます。

慌てず、しかし迅速に行動することが重要です。まずは事実確認(いつ、誰が、何の情報を、どこに漏洩させた可能性があるか)を最優先で行い、被害の拡大を防ぐ措置(当該共有リンクの削除など)を講じます。その上で、速やかに法務部門や情報セキュリティの専門家に相談し、個人情報保護委員会への報告義務の有無や、顧客への通知の要否などを判断する必要があります。初動対応を誤ると被害が拡大するため、自己判断せず、必ず専門家の助言を仰いでください。

第4章:守りのAI戦略なくして、攻めのDXはありえない

緊急対策は「応急処置」に過ぎない

今回ご紹介した対策は、あくまで緊急の応急処置です。

真の課題は、会社としてAI利用に関する明確なルール(ガイドライン)が存在しないことにあります。

これからの時代に求められる「攻めと守りのバランス」

AIを恐れて禁止するのは現実的ではありません。競合が AI を活用して生産性を向上させている中、自社だけが旧来の方法にこだわっていては、競争力の低下は避けられません。

重要なのは、「安全に、最大限活用するためのルール」を整備することです。

ドリームサウンドの提言

私たちドリームサウンドは、数多くの企業のデジタル変革を支援してきた経験から、以下を強く提言します:

AI時代の企業競争力の源泉は「安全な活用ルール」にある

- セキュリティリスクを最小化しながら、AIの恩恵を最大化する

- 従業員が安心して業務効率化ツールを使える環境を整備する

- 情報漏洩やコンプライアンス違反のリスクから会社を守る

私たちのサポート

ドリームサウンドでは、最新のAI動向とセキュリティ知見を踏まえ、各企業の状況に合わせた「AI利用ガイドライン」の策定支援を行っています。

サポート内容

- 現状のAI利用実態調査

- リスクアセスメントの実施

- 業界・規模に応じたガイドライン策定

- 従業員向け研修・説明会の実施

- 継続的なモニタリング体制の構築

まとめ:手遅れになる前に、今すぐ行動を

ChatGPTの共有リンク問題は氷山の一角です。AI技術の急速な発展に伴い、新たなリスクは次々と出現します。

今日お伝えした緊急対策を実施することが、まず第一歩。

しかし、根本的な解決には、会社全体でのAI活用戦略の策定が不可欠です。

自社のAI活用に少しでも不安を感じたら、手遅れになる前に、ぜひ一度私たちにご相談ください。

次のステップへ

この記事が、あなたのビジネスの課題解決へのヒントとなれば幸いです。もし、この戦略をあなたのビジネスに合わせて具体的に落とし込みたい、あるいは、我々ドリームサウンドの専門知識を活用したいとお考えでしたら、まずはお気軽にご相談ください。私たちは、無理な営業は一切いたしません。あなたの課題を整理し、次の一手を共に考える、最初の30分は無料です。

Passionate - Dedicated - Professional